脳型人工知能の実現に向けた新理論の構築に成功―ヒントは脳のシナプスの「揺らぎ」―

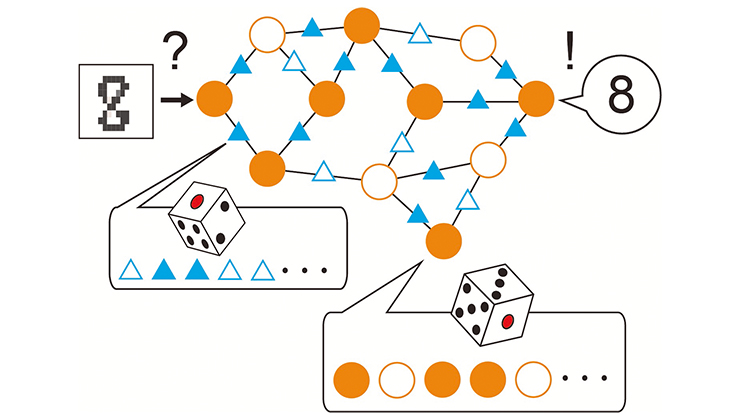

京都大学大学院情報学研究科 寺前順之介 准教授、立命館大学情報理工学部 坪泰宏 准教授の共同研究グループは、生物の脳のように揺らぐニューロン※1とシナプス※2で学習を実現する新たなニューラルネットワーク※3の構築に世界で初めて成功しました。ニューラルネットワークは現在発展を遂げている人工知能の基盤技術であり、生物の脳をヒントに提案されましたが、最適化※4という緻密な計算を必要とするため、脳のニューロンやシナプスが示す強い「揺らぎ」とは整合しない問題がありました。この「揺らぎ」とは、脳ではニューロンやシナプスが、あたかもランダムに、つまり確率的に動作することを意味し、最適化のような緻密な計算とは一致しないようにみえます。

本研究では「脳の学習は最適化ではなく、適切な具体例を生成するサンプリングではないか」と考えることでこの問題を解決し、揺らぎによって最適化なしで学習するニューラルネットワークの構築に成功しました。さらに、この新しいニューラルネットワークが脳の幾つもの実験結果を再現することも発見しました。今後、脳のような高い柔軟性を持ち省エネルギーで動作する脳型人工知能の開発や、私たち人間を含む生物の脳の仕組みの解明への波及効果が期待されます。

本成果は2022年10月21日(現地時刻)に米国の国際学術誌「Physical Review Research」にオンライン掲載されました。

背景

ディープラーニングなど、現在急発展を遂げている人工知能や機械学習の多くは、ニューラルネットワークという数理モデルによって実現されています。ニューラルネットワークは、今から50年以上前に、生物の脳の神経回路を参考に提案されたものですが、近年の脳科学の進展により、実際の脳のニューロンやシナプスの動作とは大きな違いがあることも分かってきました。特に重要な違いは、現在のニューラルネットワークは「最適化」という緻密な計算によって望ましい機能を実現しますが、脳のニューロンやシナプスは強い「揺らぎ」を持ち、あたかもランダムに、つまり確率的に動作するため、最適化のような緻密な計算をしているようにはみえないことでした。最適化の計算は膨大なエネルギーを消費するため、脳のようなランダムに動作するネットワークで高度な情報処理が可能になれば、現在のニューラルネットワークよりも遥かに省エネで、しかも柔軟な人工知能の開発が期待できます。そのため、脳のニューロンやシナプスが示す確率的性質をニューラルネットワークに導入する研究がこれまで世界中で行われてきました。しかしどのように確率を導入するかが難しかったため、確率性の部分的な導入に留まるなど、脳のニューロンとシナプスの性質に整合するニューラルネットワークの構築には成功していませんでした。そこで私たちは、このニューロンやシナプスの揺らぎは邪魔モノではなく、むしろ「揺らぎこそが脳の学習の本質」ではないか、具体的には、揺らぎだけで学習や推論を実現するニューラルネットワークが構成できるのではないかと考え、本研究プロジェクトの設立に至りました。

研究手法・成果

通常のニューラルネットワークの学習は、ニューロン同士を結びつけるシナプスの強さを、問題に最も合った一つの値に調整する最適化という過程で実現されます。しかしこの最適化の過程は、脳のニューロンとシナプスのランダムな動作は一致しません。さらに最適化の計算では、脳とは比較にならないほど多くの電力が必要になるという問題もありました。そこで本研究では、脳の学習を最適化ではなく、適切な値の具体例(サンプル)を次々と生み出す過程(サンプリング)ではないかとの仮説を立て、研究を進めました。この考え方はベイズ推定※5やベイズ学習と呼ばれる理論の一つです。そこでベイズ推定の理論の中でも、特に脳と近い性質を持つと思われたギブスサンプリング※6の理論を利用することで、脳のようにランダムなニューロンとシナプスだけで動作するニューラルネットワークの構築に成功しました。興味深いことに、このように構成されたニューラルネットワークは、動物が物を見たときに脳のニューロンが示す応答の特徴など、生物の脳の揺らぎ以外の多くの性質を再現することも発見できました。

これらの結果は、柔軟で効率的に動作する脳型人工知能の開発と、生物の脳を理解することで疾患克服も目指す脳科学の両方に重要な意義を持つと期待しています。

波及効果、今後の予定

まず本研究の波及効果が期待されるのが、脳のニューロンやシナプスを模した高度な機能素材やハードウェアによる脳型人工知能の実現を目指すニューロモルフィックコンピューティングの分野です。現在のニューラルネットワークは学習に膨大な計算量とエネルギーを必要とします。これに対し本研究の成果は、ニューロモルフィックコンピューティングを支える基礎原理として、現在のニューラルネットワークよりも遥かに低消費電力で動作する柔軟な人工知能の実現につながると期待されます。確率的な動作を基盤とするため、将来的には量子コンピュータへの応用も可能かもしれません。

脳科学や生物学にも大きな波及効果が期待されます。本研究結果は実験的に検証可能な生物学的予測も与えています。本研究の学習の仕組みが実際の脳でも見つかるかどうかの検証実験によって、脳についての新たな知見が得られると期待されます。揺らぎは、細胞内の情報伝達など、脳以外でも重要な役割を果たしていると考えられています。学習をサンプリングとして捉える今回の理論が、脳以外にも拡張できるかどうかも今後の重要な課題です。

研究プロジェクトについて

本研究は、日本学術振興会科学研究費補助金 基盤研究(C)「内的なゆらぎを駆動力とする効率的な学習システムの構築」(研究代表者:寺前順之介、課題番号:17K00338)、同 基盤研究(C)「自発的な内部ダイナミクスを利用する柔軟で効率的な時系列学習アルゴリズムの実現」(研究代表者:寺前順之介、課題番号:20K11987)、同 基盤研究(C)「感覚運動連関におけるバイアスを利用したミクロスコピックな確率的情報処理の解明」(研究代表者:坪泰宏、課題番号:19K12165)、同 基盤研究(A)「脳の情報処理原理を応用した無線センサーネットワークアルゴリズムの研究」(研究代表者:若宮直紀、課題番号:16H01719)の支援を受けて行われました。

用語解説

- ※1 ニューロン:生物の脳を構成する神経細胞。主に電気的活動によって情報を表現し、脳の情報処理を実現する。

- ※2 シナプス:脳のニューロン間を結び情報伝達を実現する接合部位。シナプスでの情報伝達の変化が生物の記憶や学習の実体だと考えられている。

- ※3 ニューラルネットワーク:脳の神経回路を模した数理モデル。生物の神経回路と区別する場合は人工ニューラルネットワークとも呼ばれる。ディープラーニングなど近年大きな成功を収めた機械学習の多くがニューラルネットワークを用いて実現されている。

- ※4最適化:ニューラルネットワークに関しては、目的の動作を実現するためにニューラルネットワークが持つ変数の値を調整することをいう。誤差逆伝播法と呼ばれる手法が代表的。

- ※5 ベイズ推定:観測された事象からその原因となった事象の確率を推定する確率的推定手法。条件付き確率に関するベイズの定理を基盤とする。

- ※6 ギブスサンプリング:与えられた確率分布に従う確率変数を近似的に生成するサンプリング手法の一つ。高次元の確率分布など直接的なサンプル生成が困難な場合に利用されることが多い。

研究者のコメント

なぜ、脳のニューロンやシナプスが強い揺らぎを示すにも関わらず、私たち人間を含む動物が安定した記憶や学習を実現できるのかは、生物学的にも工学的にも重要な未解決課題でした。今回その答えにつながる理論ができ嬉しく思っています。本研究で用いた「学習とは最適化ではなく具体例を作り続けること」という考えも、生き物らしい柔らかさと相性が良く気に入っており、今後の発展が楽しみです。(寺前順之介)

論文タイトルと著者

- タイトル:Dual sampling neural network: Learning without explicit optimization(二重サンプリングニューラルネットワーク:明示的な最適化なしの学習の実現)

- 著者:Jun-nosuke Teramae, Yasuhiro Tsubo

- 掲載誌:Physical Review Research

- DOI:10.1103/PhysRevResearch.4.043051